Livestream in Echtzeit manipulieren

| 07. Februar 2019

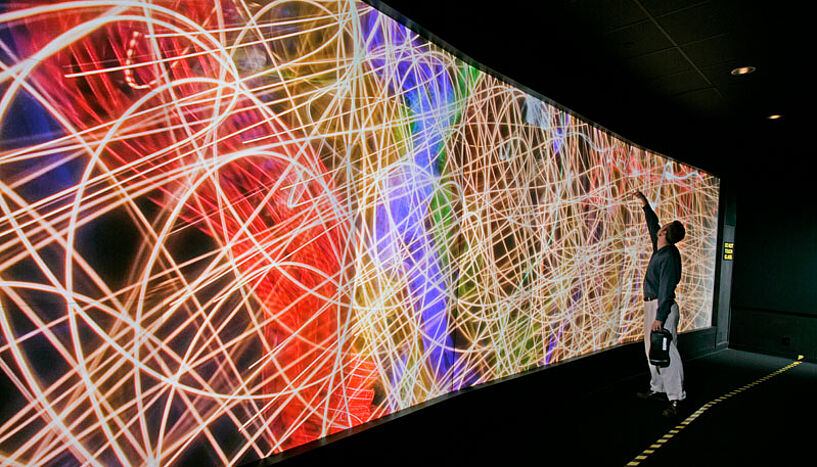

Um den Livestream später zu manipulieren, wird vor dem Dreh der Raum per 3D-Sensor (hier auf einem Tablet montiert) gescannt. (© Erwin Andre)

In der Forschungsgruppe rund um Helmut Hlavacs an der Fakultät für Informatik wird u.a. untersucht, wie Videos manipuliert – und Videomanipulationen erkannt – werden können. Informatik-Student Erwin Andre hat eine originelle Methode entwickelt, um Videoaufnahmen "live" zu verändern.

Unter dem Schlagwort "Diminished Reality" (etwa: "verminderte Realität") wird schon seit Jahren versucht, bestimmte Objekte bzw. Personen auf Videos zu erkennen und durch andere Bildelemente zu ersetzen, sodass für den Zuseher ein plausibler Gesamteindruck entsteht.

"Mittels Deep Learning kann man heute bereits alle Objekte oder Personen in einem Video in Echtzeit erkennen", erklärt Helmut Hlavacs, Leiter der Forschungsgruppe Entertainment Computing an der Fakultät für Informatik der Universität Wien. Einzelne Personen, Gesichter, Autos, Motorräder, jede Art von Tätigkeit lassen sich so in Echtzeit identifizieren und einfach aus dem Video entfernen.

Das Problem ist nicht so sehr das Entfernen, sondern die Frage, wie man das dabei entstehende "Loch" füllt. Bei mehr oder weniger einfarbigen und ruhigen Hintergründen funktioniere das ganz gut, da könne man aus den das Objekt umgebenden Bildelementen auf den notwendigen Hintergrund rückschließen. "Wenn der Hintergrund aber sehr auffällig ist und viele Details hat, beispielsweise ein Bücherregal, funktioniert das gar nicht", so der Informatiker.

3D-Modell des Raumes wird eingefügt

Erwin Andre, Studierender an der Fakultät für Informatik, hat in seiner Abschlussarbeit einen anderen Ansatz verfolgt. Er rüstete ein handelsübliches Tablet mit einem 3D-Sensor auf. Mit diesem wird zunächst der Hintergrund – beispielsweise ein kompletter Raum, in dem später gefilmt werden soll – gescannt. Dieses 3D-Modell wird dann dort eingefügt, wo ein Objekt oder eine Person aus dem Bild entfernt wurde. Das Ganze funktioniert in Echtzeit, also auch bei einer Liveübertragung, und bei wechselnder Kameraposition.

Manipulierte Videos automatisch erkennen

Anwendungen solcher Methoden kann sich Hlavacs etwa in der Film- und Werbeindustrie vorstellen, aber auch für Menschen mit Asperger Syndrom, die bei zu vielen Details optisch schnell überfordert sein können. Und natürlich könne man so eine Technologie auch missbrauchen, "deshalb wollen wir auch verstehen, wie solche Ansätze funktionieren, und uns dann überlegen, wie man manipulierte Videos automatisch erkennen kann".

Derzeit könne man noch davon ausgehen, dass man bei Liveübertragungen durch solche Manipulationen noch kleine Bildfehler sieht. "Es funktioniert schon sehr gut, aber hie und da gibt es ein kleines Wackeln, es wird unscharf, oder das eingefügte Bild passt nicht ganz", so Hlavacs. Wenn man gespeichertes Material im Nachhinein manipuliere, sei ein Nachweis schwieriger, "dann muss man sich das Material mit forensischen Methoden anschauen". (APA/red)